自从 Deepfake 技术面世以来,就一直朝着不可控的方向发展。

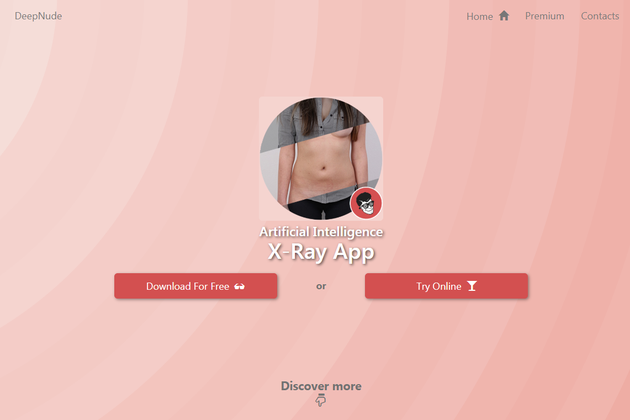

从开始被用在小电影给女明星换脸,到美国总统特朗普、Facebook CEO 扎克伯格等公众人物相继成为 DeepFake 技术的受害者,再到「一键脱衣」的 app「DeepNude」,DeepFake 技术带来的负面影响愈加明显。

更令人担心的是, Deepfake 技术还在不断进化。斯坦福等几所高校此前发布的一项研究甚至能篡改视频的语句,只要输入任意文本,就能让视频中的演讲者说出对应的话,比如将电视台主持人报道的「苹果股价收盘于 191.45 美元」的数字改为「182.25 美元」。

尽管这两个词的发音和口型完全不同,但几乎看不出修改痕迹。研究者经过调查发现,59.6% 的受试者认为被修改过的视频是真的,这项技术成功骗过了大部分人的眼睛。

Deepfake 技术让网络世界变得更加真假难辨,与此同时不少科学家和机构也开始研发鉴别 Deepfake 的技术,开始了一场猫捉老鼠的游戏。

据《华尔街日报》报道,本周在拉斯维加斯举办的黑帽网络安全大会上,来自俄勒冈大学的研究人员提出,老鼠等小动物未来或有助于鉴别伪造的视频和音频。

▲图片来自:The Scientist.

研究人员发现,老鼠在识别自然语音元素方面很有天分,能听出声音中的不规则性,比如通过训练能区分 P、B、T 等不同音素,以及不同元音发声的区别,从而识别复杂的声音,并检测音频的真实性。

科学家将条件反射来训练小老鼠,让老鼠在听到真实和合成视频的时候分别跑向不同位置,如果识别正确就给予奖励,在测试过程中老鼠识别假音频的准确率达到 75%。

虽然当研究人员在添加一些新的声音和元音的等变量后,老鼠识别的准确率有所下降,当在经过一段时间的训练后,还是能够区分新的语音模式。

该研究项目成员之一,俄勒冈大学研究生 Jonathan Saunders 认为,该技术还可以进一步优化,形成通用版本的 Deepfake 检测算法,但这需要更深入了解大脑是如何分析和处理声音的。

尽管老鼠在听觉研究领域有着很大潜力,但这也不意味着社交平台和视频网站将来通过饲养大量的老鼠就能够鉴别 Deepfake 假视频。研究人员是希望通过弄明白老鼠是如何识别假音频,从而更好地训练机器来对抗 Deepfake 。

除了之外,目前很多研究团队都采用生成式对抗网络(GAN)来鉴别 Deepfake ,以 AI 对抗 AI。

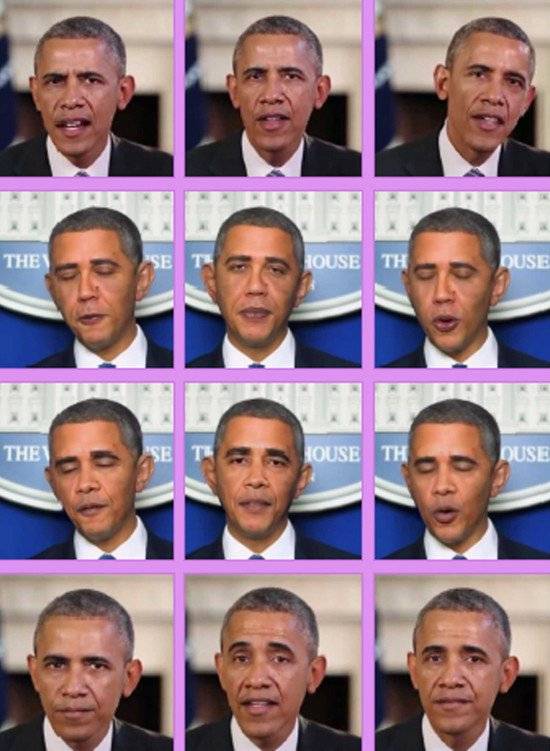

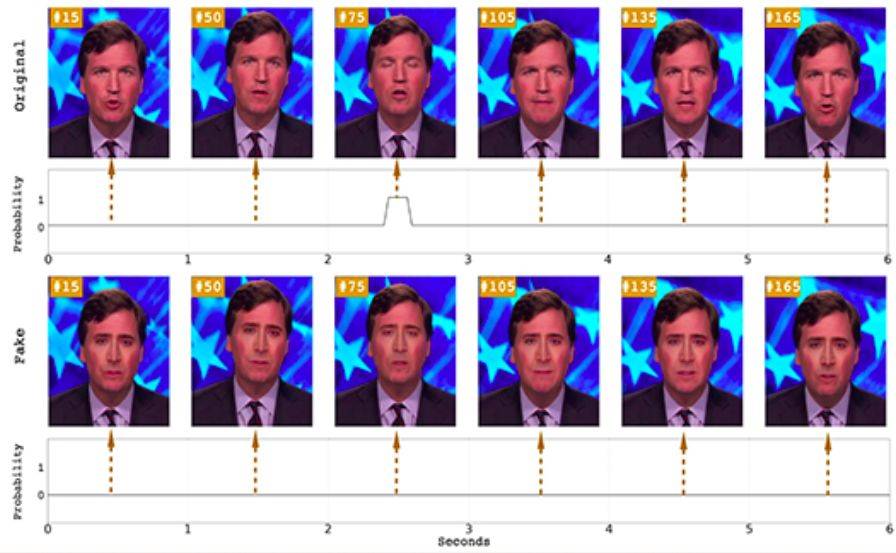

前不久加州大学伯克利分校和南加州大学的研究团队就开发了一套 AI 鉴别系统,先通过生成式对抗网络,提取特朗普、希拉里和奥巴马等人的面部、头部运动特征,合成假视频。

随后再用机器学习分析真假视频的差异,从而得到每个人的「软性生物特征」(soft biometric signature),识别出细微的动作特征,这种检测工具识别 Deepfake 视频的准确率达到 95%,研究人员希望能在未来半年内提升至 99%。

去年美国国防部研究机构 DAPRA 也研发出一个专门打假 Deepfake 的 AI 工具,抓住了 AI 生成的人脸缺乏眨眼功能的缺陷,通过检测眼睛状态判断视频的真假,准确率高达 99%。

▲在原始视频(上图)中,在 6 秒内检测到眨眼动作。而 Deepfake 生成的假视频(下图)则没有眨眼. 图片来自: UAlbany.edu

遗憾的是,这套工具无法大规模地应用,研究人员正在试图开发出一款可扩展的平台化工具,能对网络上大量的视频进行鉴别。

不过这种利用 AI 对抗 AI 的鉴别方式也存在问题,因为生成式对抗网络的原理就是让两套神经网络在相互博弈中学习,随着鉴别技术的提升,假视频的质量也会进一步提高,两者永远处在不断的对抗当中,谁也无法彻底打败谁。

▲ 图片来自:allure

同时相比起 Deepfake 技术的研发,鉴别技术的科研力量显得有点势单力薄。据 DeepTrace 平台统计,,2018 年,全球涉及 GAN 生成图像和视频的论文多达 902 篇,而研究如何识别合成图像和视频的论文只有 25 篇。

加州大学伯克利分校的计算机科学家 Hany Farid 也指出,目前研究合成视频和鉴别的人数是 100:1, Farid 认为依靠技术现有的鉴别技术难以阻止 Deepfake 视频在社交平台上传播:

解决方法不能只靠技术,还需要媒体专业的报道,以及更好的数字公民、公司和政策。

题图来自:BBC

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

from 爱范儿 https://ift.tt/2OQTGh1

via IFTTT

没有评论:

发表评论